近日,我校人工智能学院许悦雷教授领衔的无人系统智能感知与认知团队自主研发的空地协同感知系统,在不同领域复杂环境中经受住了严苛考验,该系统集“敏锐视觉”与“智慧大脑”于一体,兼具高空俯瞰与地面洞察能力,可实现毫秒级主动预警与风险防控。这一成果标志着团队在智能感知领域的研究取得了突破性进展,为提升无人系统实战效能提供了强有力的技术支撑。

云端“苍鹰”:让每一个目标都无处遁形

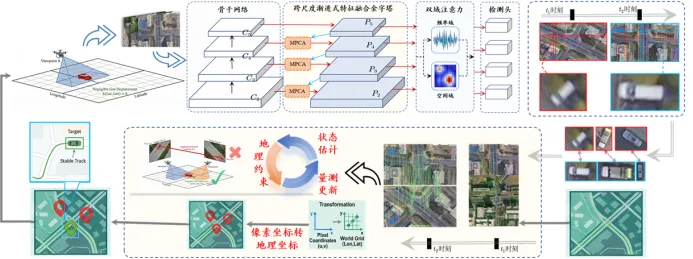

在执行侦察任务中,无人机就像翱翔云端的“苍鹰”。然而从数百米高空俯瞰地面目标往往微若尘埃,画面模糊、特征极弱,一旦目标遁入树林、躲进暗巷,传统跟踪系统便极易因“看不清、追不准、认不出”而“掉链子”。“目标太小看不到、轨迹弯绕追不准、消失再现认不出”,团队针对这三道“坎”逐一攻克。

复杂环境下空对地目标感知

弱小目标看得见——团队设计了一套“智能聚焦”机制,如同给系统配了一副能自动对焦、滤霾的“神奇眼镜”,即便天气恶劣、图像模糊也能清晰还原目标轮廓与细节。同时,通过轻量化优化确保在无人机机载设备上实现实时处理。

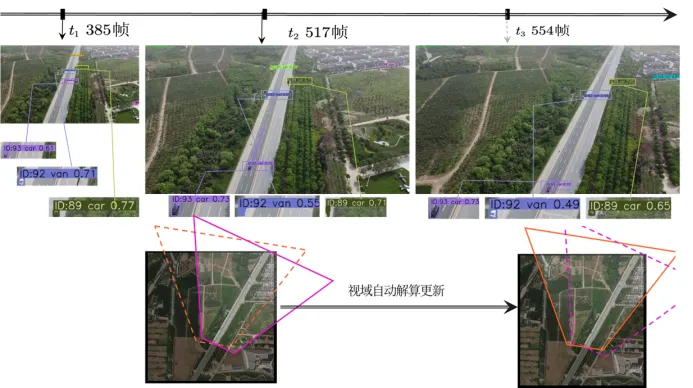

复杂轨迹追得准——针对地面目标行踪飘忽不定,传统“直线外推”逻辑遇上复杂路线便失效的难题,团队研发了轨迹预测模块。既能回溯目标走过的路径,又能前瞻下一步去向。“瞻前顾后”相互印证,让预判更加精准可靠。

地面目标连续跟踪与动态预判

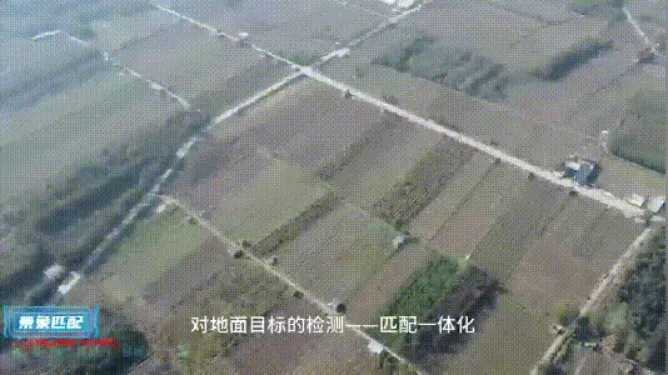

拒止环境记得住——团队创新采用“地理定位”取代“人脸识别”,系统通过整合无人机飞行高度、GPS坐标、摄像头姿态等多种信息,将画面像素实时转化为真实地理坐标。即便在目标消失或GPS拒止环境下仍能利用实景匹配与轨迹推算锁定位置,当目标重新出现,系统综合位置、运动习惯、行走姿态等线索立刻“对上号”。

目标重识别与连续跟踪演示

为验证系统效果,团队自主建立了涵盖城区、山区、沙漠等多种地形的无人机视频数据集,覆盖低、中、高空等多种飞行高度,全面检验系统可靠性。团队依托该技术获得多个国家级创新比赛第一名或一等奖,核心模块在多个有无人机部署应用。同时,已与相关一线部门展开合作开发,持续深化推进。

目标地理定位与运动信息解算演示

地面“卫士”:让每一个角落都尽在掌握

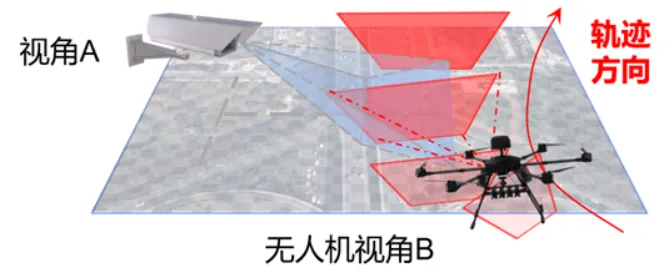

在城市的十字路口与大型商圈,地面交通监控与低空巡逻无人机虽已广泛应用,却长期处于“各自为战”的状态。地面摄像头视角受限,高空设备则因成像差异难以与地面画面融合。即便强行整合,高昂的算力成本与上百毫秒的延迟也往往让应急指挥错失处置良机。如何破解这一难题?团队的答案是:让高点设备与地面摄像头“说同一种语言”,从被动记录走向主动预判、提前预警。

空地协同视角感知与空间对应关系

说同一种话——该系统的核心创新在于摒弃传统的“外貌认人”思路,转而采用基于空间的“靠位置对号入座”方案,这一变革有效解决了因高空与地面视角差异导致的车辆外观特征不一致难题,通过统一空间语言实现了对同一目标的跨视角精准锁定。此外,团队还专门研发了“防畸变修补方案”,确保高点设备在极速机动状态下系统依然能够保持稳定运行。

跑同一条路——有了统一的“语言”,系统便能无缝衔接不同设备的目标信息,真正实现“全城接力、永不掉线”。无需大规模更换现有设备,通过算法与软件升级,原有普通摄像头便能“老树发新芽”,以极低成本实现智能化跃升。

想同一件事——区别于传统监控“只记录、不干预”的被动模式空地协同感知系统更像一位随时待命的“预警指挥官”,持续研判路口人流、车流动态。一旦预判潜在风险,即刻主动推送疏导建议并锁定危险区域,大幅压缩响应时间,实现风险防控“抢先一步”。

多视角协同道路目标感知

系统在2025年成都世运会期间经受住实战考验,获得相关部门高度评价。目前,团队已与交管部门达成深度合作,用“新技术”赋能“老设备”推动智慧交通系统在更多城市场景落地应用。

从硬核技术到智慧方案,西工大无人系统智能感知与认知团队始终坚守“让有用的科技真正落地”的初心持续深耕。未来,团队将继续推动更多创新成果在应急救援、智慧交通、低空安防等领域落地生根,为社会安全与智慧发展贡献更多“西工大力量”。

(文字:王翠萍、张兆祥;审核:徐晓峰、付怡)